¿Qué es la Negligencia Artificial? Anatomía de un Riesgo Humano

A ver, vamos a poner las cartas sobre la mesa. Llevamos meses flipando con lo que la IA puede hacer, pero rara vez nos paramos a pensar en lo que nosotros estamos dejando de hacer. La negligencia artificial no es un fallo del algoritmo, bro; es una omisión puramente humana. Se trata de ignorar los estándares mínimos de diseño, seguridad y gobernanza con tal de sacar la herramienta más brillante antes que la competencia.

Hay una diferencia abismal entre un error técnico —un «bug» inevitable que surge en sistemas complejos— y la falta de supervisión. Mientras que el error es accidental, la negligencia es sistémica. El problema real viene con la escalabilidad del daño. En el software tradicional, un descuido afecta a un módulo; en la IA, un descuido en el entrenamiento se automatiza y se multiplica por millones de interacciones en segundos. No es que la máquina sea «mala», es que le dimos las llaves del coche sin comprobar si tenía frenos.

- Definición técnica: Incumplimiento del deber de diligencia en el desarrollo y despliegue de modelos.

- El factor humano: La supervisión no es un «check» al final del proceso, es el proceso mismo.

- Multiplicador de riesgo: La automatización convierte un sesgo pequeño en una discriminación masiva.

Los Pilares del Error: Datos, Velocidad y Opacidad

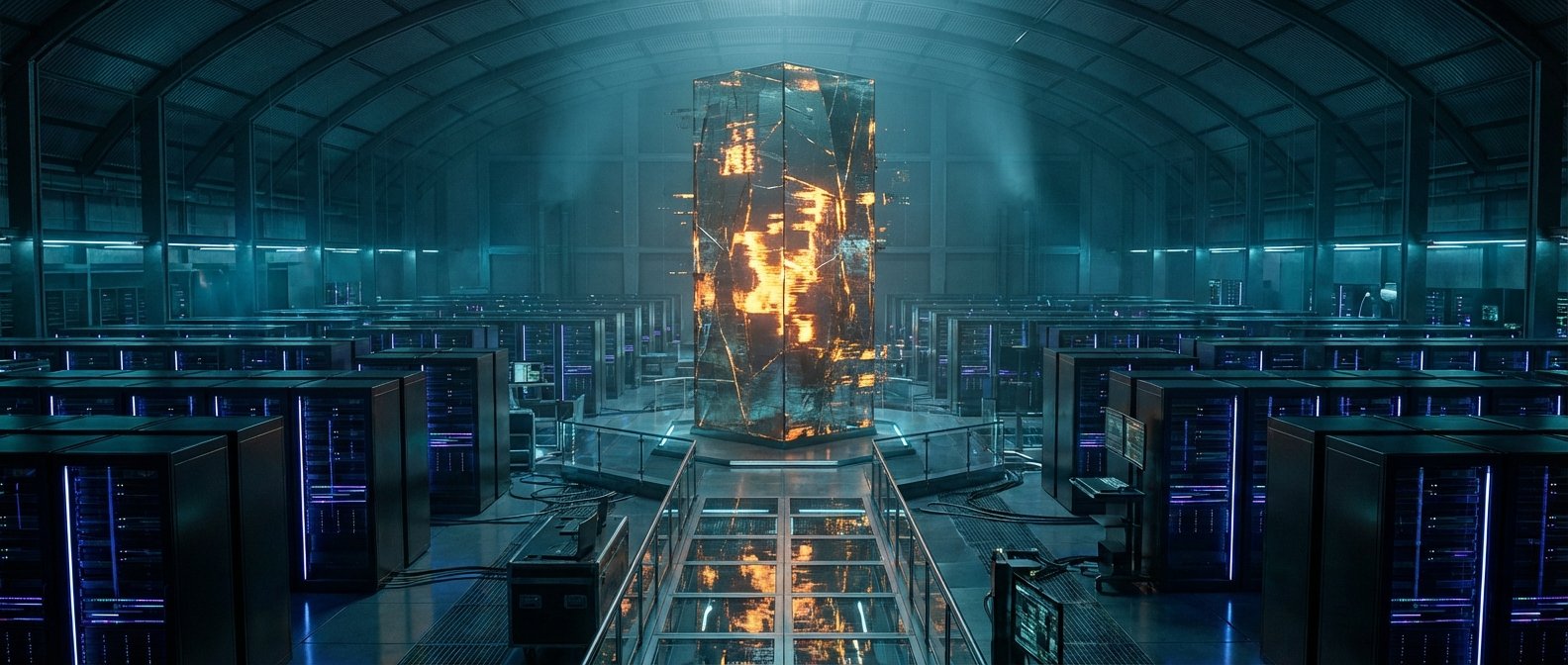

Vivimos en la era del «muévete rápido y rompe cosas», pero cuando lo que rompes es la confianza o la seguridad de los usuarios, el lema pierde la gracia. La prioridad absoluta por el Time-to-Market está canibalizando las auditorías de seguridad. Se lanzan modelos que son auténticas cajas negras; sabemos qué entra y qué sale, pero el «cómo» se queda en una nebulosa de pesos algorítmicos que nadie puede explicar. Esta crisis de trazabilidad es el caldo de cultivo perfecto para la negligencia.

Ojo con esto: la economía extractiva de datos también juega su papel. Entrenar modelos con datasets masivos sin consentimiento o con sesgos brutales no es solo un dilema ético, es un fallo técnico de base. Si los cimientos están podridos (datos sesgados), el edificio (el modelo) acabará cayendo, por muy potente que sea el servidor que lo aloja.

Jerarquía del Colapso: El Flujo de Responsabilidad Técnica

Para entender dónde se tuerce todo, hay que mirar el flujo de trabajo. La negligencia suele filtrarse en las fases tempranas: un entrenamiento contaminado que no se filtra correctamente o una validación de modelo que se hace «por encima». Aquí es donde la XAI (Explicabilidad de la IA) se vuelve crítica. Si no podemos entender por qué el sistema tomó una decisión, no podemos corregir el fallo sistémico antes de que ocurra.

Identificar los puntos críticos de intervención humana no es opcional. Necesitamos protocolos donde el humano no sea un simple espectador, sino un validador activo en cada estrato de la jerarquía, desde la integridad del dato inicial hasta la salida ética final. Si el flujo se rompe en la base, el colapso en la cima es inevitable.

Consecuencias Sistémicas: Del Arte a la Democracia

Al lío con las consecuencias, porque no son moco de pavo. La negligencia en el despliegue de IAs generativas ya está golpeando con fuerza la propiedad intelectual. El desplazamiento del valor creativo es real cuando se permite que los modelos operen en un vacío de derechos de autor. Pero el riesgo va más allá de lo económico: la desinformación masiva y la erosión de la confianza en las instituciones digitales son subproductos directos de soltar algoritmos sin control de veracidad.

«El vacío legal actual es un campo de juegos para la irresponsabilidad. Asignar responsabilidades jurídicas a un sistema automatizado es un error; la responsabilidad siempre tiene una firma humana detrás.»

Estamos ante un dilema de confianza. Si las empresas no asumen la autoría de los fallos de sus sistemas, la ciudadanía digital empezará a ver la tecnología no como una herramienta de progreso, sino como un riesgo estructural para la democracia y la verdad.

El Manifiesto de la Responsabilidad: Soluciones y Ética

Entonces, ¿cómo arreglamos este desaguisado? La solución pasa por implementar auditorías externas obligatorias y sesiones intensivas de Red Teaming. Hay que intentar romper el sistema antes de que lo haga el mundo real. Me gusta usar la analogía del cuchillo: un cuchillo es una herramienta increíble, pero nadie lo vende sin un mango seguro y un control de calidad que garantice que no se va a partir en la mano del usuario.

La innovación segura no es un freno al progreso, es lo que permite que el progreso sea sostenible. Necesitamos una ciudadanía digital activa que no se conforme con cajas negras, sino que exija transparencia y rendición de cuentas. Al final del día, el control de los parámetros éticos y los cierres de seguridad son los que separan una herramienta útil de un caos técnico anunciado.