El fin del televisor pasivo

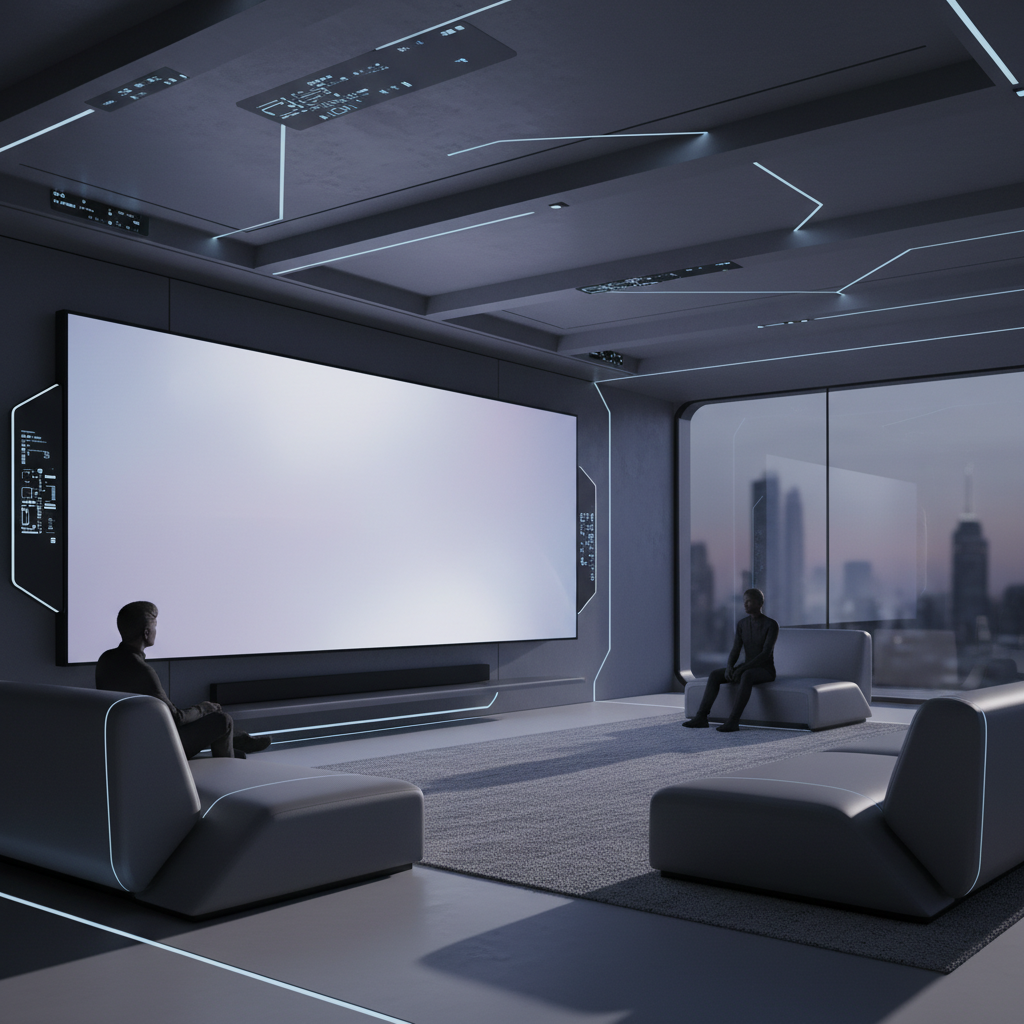

Admitámoslo: el televisor se ha quedado «tonto». Durante años, nuestra interacción con la Smart TV se ha limitado a navegar por menús infinitos, sufrir búsquedas por voz que apenas entienden nuestro dialecto y perder minutos preciosos buscando qué ver. Es una reliquia de la era de la navegación estática que, por fin, tiene fecha de caducidad.

Al lío: la llegada de Gemini a Google TV no es solo un «lavado de cara». Estamos hablando de convertir al televisor en un motor multimodal. Ya no se trata de que el sistema entienda una cadena de texto para buscar un título en Netflix; se trata de que la IA comprenda el contexto, la imagen, el vídeo y tu propia intención, transformando un simple receptor de señales en un asistente visual proactivo.

Arquitectura de una experiencia inteligente

¿Cómo demonios logran que esto no vaya a pedales? La magia reside en un equilibrio delicado entre el procesamiento local (para latencia cero) y la potencia de la nube. La arquitectura de Gemini en Google TV no es monolítica; utiliza modelos optimizados que se ejecutan en el hardware del televisor para tareas rápidas y delega el análisis pesado a servidores de Google.

Esto permite una integración profunda mediante APIs. Imagina que el sistema no solo busca «películas de acción», sino que es capaz de sintetizar guiones, crear resúmenes de lo que te perdiste en el episodio anterior o desplegar paneles dinámicos con estadísticas que se ajustan al contenido en pantalla. Es, básicamente, ponerle un cerebro capaz de razonar a tu panel 4K.

De datos a píxeles: ¿Cómo fluye la información?

A nivel técnico, es un proceso fascinante. El ciclo del usuario empieza en el lenguaje natural: le hablas a tu mando y la IA descompone esa intención en vectores de datos. Estos vectores no solo ejecutan una orden, sino que alimentan un motor de inferencia multimodal.

Ojo con esto: el sistema traduce esos datos en una interfaz dinámica jerarquizada. No es una imagen fija, es código renderizado en tiempo real que se despliega sobre tu contenido. El resultado es una capa de información que «entiende» qué estás viendo y cuándo es el momento adecuado para interrumpirte con datos relevantes.

Aplicaciones reales: del sofá a la cocina

Todo esto suena muy bien sobre el papel, pero ¿para qué nos sirve en el mundo real? Aquí es donde la IA empieza a brillar de verdad:

- Multitarea deportiva: ¿Estás viendo el partido? Gemini puede mostrarte estadísticas de jugadores en una esquina sin tapar la acción principal.

- Aprendizaje «manos libres»: Si estás siguiendo una receta en YouTube, la IA puede pausar, resumir los pasos o incluso explicarte por qué se está cortando una salsa, todo mediante comandos de voz naturales.

- Contexto inteligente: El sistema sabe quién está en el salón y a qué hora. No te sugerirá dibujos animados a las 11 de la noche cuando estás viendo un thriller, ni te mostrará recordatorios de trabajo si detecta que estás en modo relajación.

Privacidad y el futuro del ecosistema

Sé lo que estás pensando: «¿Me va a estar espiando la tele?». La gestión de datos es el talón de Aquiles de cualquier asistente. La tendencia aquí es el procesamiento local para consultas sensibles y la anonimización total en la nube. La privacidad no es un añadido, es la base de esta arquitectura.

El futuro es claro: el televisor se convertirá en el hub central de tu casa inteligente. No solo verás contenido; gestionarás tu ecosistema (luces, temperatura, seguridad) a través de una interfaz que Gemini organiza por ti. Al final del día, el valor real de esta tecnología no es que sea «más potente», sino que sea lo suficientemente inteligente para simplificar nuestra experiencia, evitando que nos sintamos abrumados por la cantidad de opciones. Y eso, amigo, es progreso real.