El Salvador y xAI: La Anatomía de una Tutoría Nacional

Vamos al lío. Si has estado siguiendo las noticias tech en Latam, sabrás que el ambiente está caldeado. Pero lo de El Salvador no es solo un titular llamativo; es un despliegue de infraestructura masiva. La reciente alianza entre la administración de Bukele y Elon Musk para integrar Grok (xAI) en el sistema educativo público es, posiblemente, el experimento de «EdTech» más ambicioso de la década.

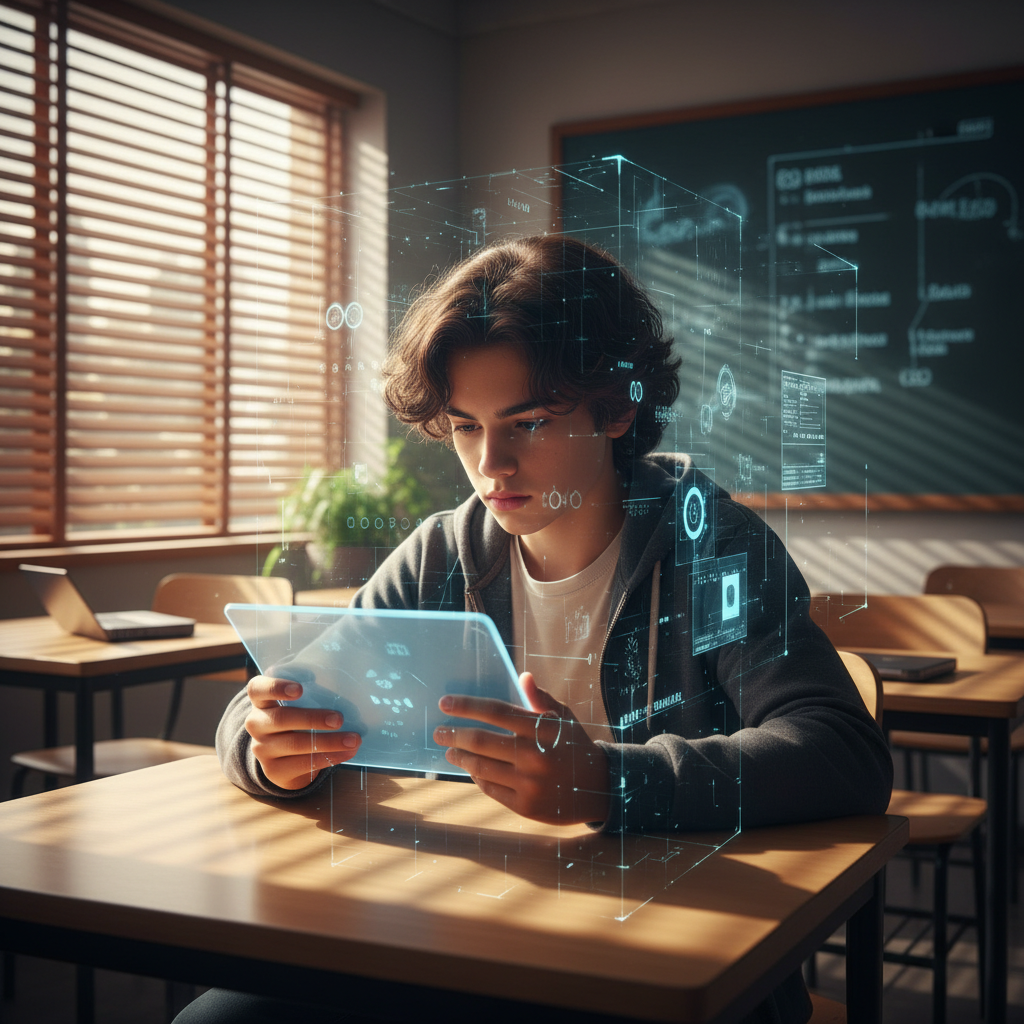

No estamos hablando de repartir tablets y desear suerte. Aquí hay una arquitectura técnica seria detrás. El plan consiste en integrar LLMs (Grandes Modelos de Lenguaje) directamente en el currículo nacional. La idea es atacar un problema de escalabilidad clásico: el ratio profesor-alumno. En muchas zonas, un solo docente no puede personalizar la enseñanza para 40 estudiantes.

- El Stack: Se utilizan módulos de xAI para generar tutores virtuales que responden dudas 24/7.

- La Meta: Escalar esto a 5,000 escuelas. Estamos hablando de un millón de estudiantes interactuando con una IA que aprende de sus patrones de duda.

- La Diferencia: A diferencia de ChatGPT genérico, esto promete estar «mapeado» con los libros de texto oficiales del país.

México y el Ojo Digital: La IA como Vigilante de Exámenes

Ahora, cambiemos de tercio y miremos hacia el norte, a México. Mientras El Salvador apuesta por la tutoría generativa, instituciones como la UNAM y el IPN han estado coqueteando con el otro lado de la moneda: la vigilancia o proctoring. El caso ECOEMS es el ejemplo perfecto de cómo la tecnología puede volverse… intensa.

Aquí la IA no está para explicarte álgebra, sino para asegurarse de que no hagas trampas. Estos sistemas utilizan visión por computadora para procesar en tiempo real el feed de tu webcam. Buscan patrones anómalos: ¿Miraste a la izquierda demasiado tiempo? ¿Hay un segundo dispositivo en el encuadre? ¿Se escucha una voz de fondo?

Ojo con esto: El dilema del «falso positivo» es real. Imagina que el algoritmo decide anular tu prueba de acceso a la universidad porque la luz cambió o porque leíste la pregunta en voz alta. Sin una apelación humana clara, estamos dejando el futuro académico en manos de un if/else glorificado.

Desmontando el Algoritmo: Del Input al Feedback Docente

Para entender cómo debería funcionar esto idealmente (sin caer en la distopía), hay que abrir el capó del sistema. No es magia, bro, es procesamiento de datos. El modelo funciona mediante un bucle de aprendizaje continuo.

Cuando un estudiante lanza una duda (el Input), la IA no solo escupe una respuesta de Wikipedia. Primero, hace un análisis semántico y lo cruza con el Mapa Curricular Oficial. Si el alumno no entiende la «Revolución Francesa», la IA sabe qué conceptos previos fallan y ajusta la explicación.

Pero aquí viene la clave técnica: el HITL (Human in the Loop). La IA no debe reemplazar al profe. Su trabajo es generar un reporte de métricas. Piensa en esto como un GPS. El sistema le dice al docente: «Oye, detecto un atasco cognitivo en el 30% de la clase con las fracciones». Así, el profesor puede actuar quirúrgicamente donde más se necesita, en lugar de dar la misma charla genérica para todos.

La Letra Pequeña: Datos, Soberanía y Brecha Digital

Todo esto suena muy Cyberpunk, pero hay que bajar a la tierra. Como técnico, veo tres bugs potenciales en el sistema que no se solucionan con un parche de software.

«Una IA de última generación es un pisapapeles muy caro si no tienes una conexión estable. El hardware (infraestructura) siempre gana al software.»

Primero, la privacidad de los menores. Estamos hablando de entrenar modelos corporativos (como los de xAI) con datos de comportamiento de niños salvadoreños. ¿Quién es dueño de esos datos? ¿Qué pasa si el modelo alucina y enseña algo incorrecto? Segundo, la brecha digital. Implementar esto en la capital está bien, pero en una escuela rural sin 4G estable, la latencia hará que la experiencia sea frustrante.

Y finalmente, el sesgo algorítmico. Importar modelos entrenados mayoritariamente en inglés y con contextos occidentales a la realidad latinoamericana tiene riesgos. La IA debe entender el contexto cultural local, no imponer una visión externa.

Conclusión: ¿Copiloto Educativo o Piloto Automático?

Para cerrar, mi visión «JayCrafted» es clara: la tecnología ofrece una escala que ningún humano puede igualar, y eso es brutal para democratizar el acceso al conocimiento de alto nivel. Pero requiere auditoría constante y «guardarraíles» éticos robustos.

La IA en el aula debe ser un copiloto. Su función es liberar al docente de la tarea repetitiva (corregir, detectar patrones básicos) para que pueda dedicarse a lo que la máquina no puede hacer: empatizar, motivar y guiar. Si usamos la IA para poner el sistema educativo en «piloto automático» y desentendernos, nos vamos a estrellar.

El futuro inmediato no va de quién tiene el mejor algoritmo, sino de quién implementa las mejores políticas de protección de datos antes del despliegue masivo. Nos leemos en la próxima actualización del sistema.