La propuesta del Hospital Virgen Macarena

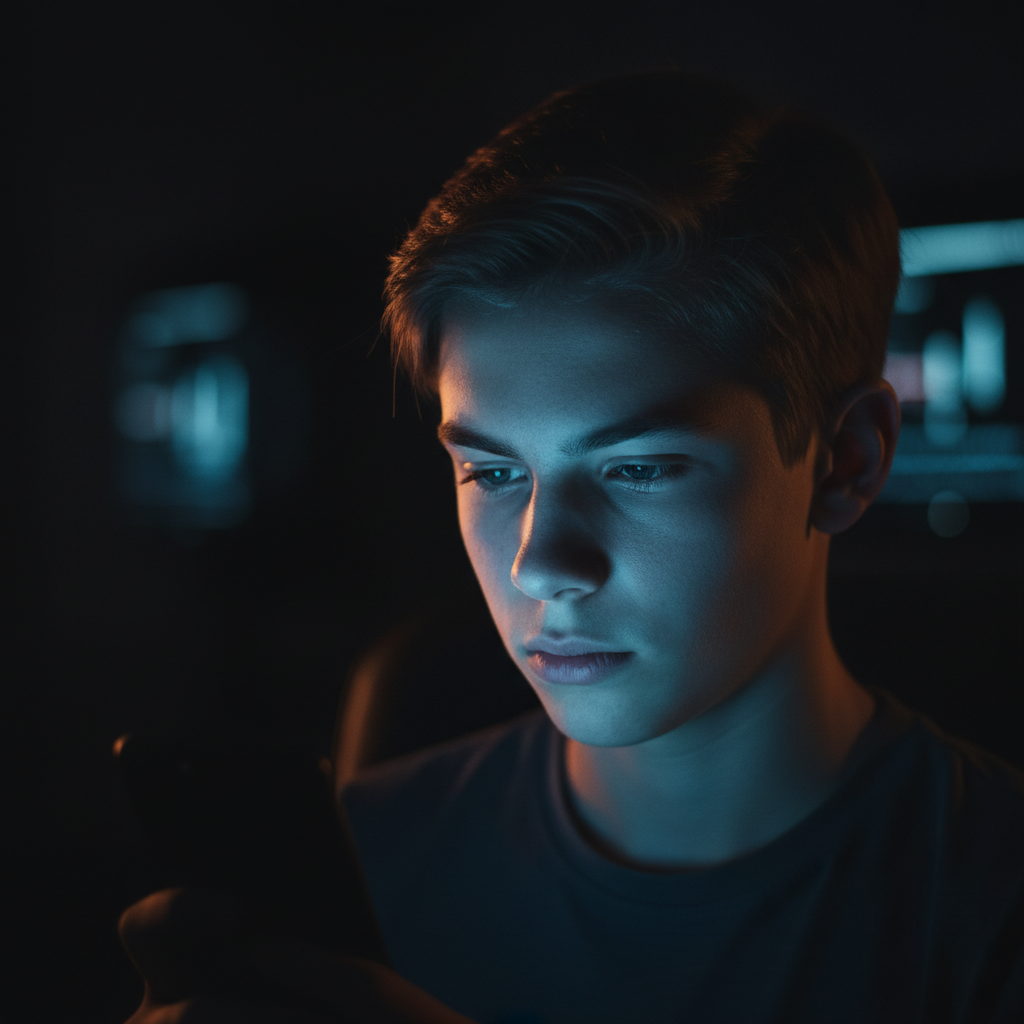

Cuando escuchamos «IA y redes sociales», lo primero que nos viene a la cabeza es el bombardeo constante de publicidad o esos algoritmos que nos mantienen atrapados haciendo scroll infinito. Pero, ¿y si cambiáramos las tornas? Aquí es donde entra al lío el Hospital Virgen Macarena, con una propuesta que me ha parecido brillante: dejar de tratar la inteligencia artificial como una herramienta de consumo para convertirla en una capa de protección activa.

No estamos hablando de teorías abstractas. La investigación del Macarena busca aterrizar el flujo de datos directamente en la prevención de riesgos en adolescentes. Es un cambio de paradigma total: pasar de usar la IA para captar nuestra atención a usarla para detectar señales de alerta temprana en un entorno tan complejo como el digital. Amigo, esto es tecnología con propósito.

Arquitectura de la prevención digital

¿Cómo narices detecta una máquina algo tan humano como el riesgo de suicidio? La clave está en el Procesamiento del Lenguaje Natural (NLP). El sistema no solo «lee» palabras, sino que analiza patrones conductuales y cambios en el tono del discurso que, a menudo, pasan desapercibidos para los moderadores humanos.

La idea es que, mediante estos modelos, los sistemas de recomendación aprendan a ser adaptativos. Si el algoritmo detecta un perfil de riesgo, en lugar de sugerir contenido viral que podría ser nocivo, empieza a priorizar contenido protector y de bienestar. Es, en esencia, reprogramar el entorno digital del usuario para que sea un espacio menos hostil.

Funcionamiento: La IA como ‘escudo’ en tiempo real

Ojo con esto: la privacidad es innegociable. El monitoreo ocurre de forma privada y sin exponer la identidad del usuario a terceros. El sistema opera como un filtro que, ante la detección de señales de alerta, escala la respuesta de forma automática.

- Fase de entrada: Análisis de lenguaje y comportamiento.

- Procesamiento: La IA evalúa la urgencia del caso.

- Respuesta: Desde mostrar recursos de ayuda hasta, en casos críticos, facilitar la activación de soporte humano profesional.

Ética, sesgos y el reto de la privacidad

No todo es color de rosa, y es mi deber como techie ser crítico. Implementar esto a gran escala nos plantea retos brutales. Por un lado, tenemos el problema de los «falsos positivos»: ¿qué pasa si el sistema confunde una expresión artística o una jerga adolescente con una conducta de riesgo? La transparencia en estos procesos debe ser total.

La auditoría algorítmica no es un capricho, es la garantía de que estamos protegiendo a los usuarios en lugar de etiquetarlos injustamente.

Necesitamos marcos regulatorios sólidos. No podemos dejar en manos de una «caja negra» la salud mental de miles de jóvenes sin un control humano riguroso que valide las decisiones de la IA.

Conclusión: El algoritmo como escolta digital

La tecnología no es una bala mágica. Jamás sustituirá el apoyo de una red humana, pero puede actuar como ese «escolta» que detecta cuando alguien se desvía del camino. La clave del éxito, según veo, es la cocreación: si no incluimos a los propios jóvenes en el diseño de estas herramientas, estaremos construyendo una solución para un problema que no terminamos de entender.

Al final, se trata de utilizar la misma arquitectura que intenta robarnos el tiempo para devolvernos algo mucho más valioso: la oportunidad de pedir ayuda a tiempo.