El Nuevo Frente Digital: ¿Por qué Silicon Valley Mira al Pentágono?

¡Qué tal, makers! Hoy nos metemos en un charco de los gordos, de esos que definen décadas. Durante años, la narrativa en Silicon Valley era clara: «IA para el bien común» y prohibiciones tajantes sobre el uso militar. Pero algo ha cambiado. OpenAI ha modificado discretamente sus políticas de uso, eliminando la prohibición explícita de «fines militares» para centrarse en «no causar daño». Parece un matiz semántico, pero en el mundo de la ingeniería de sistemas, un cambio de flag lo cambia todo.

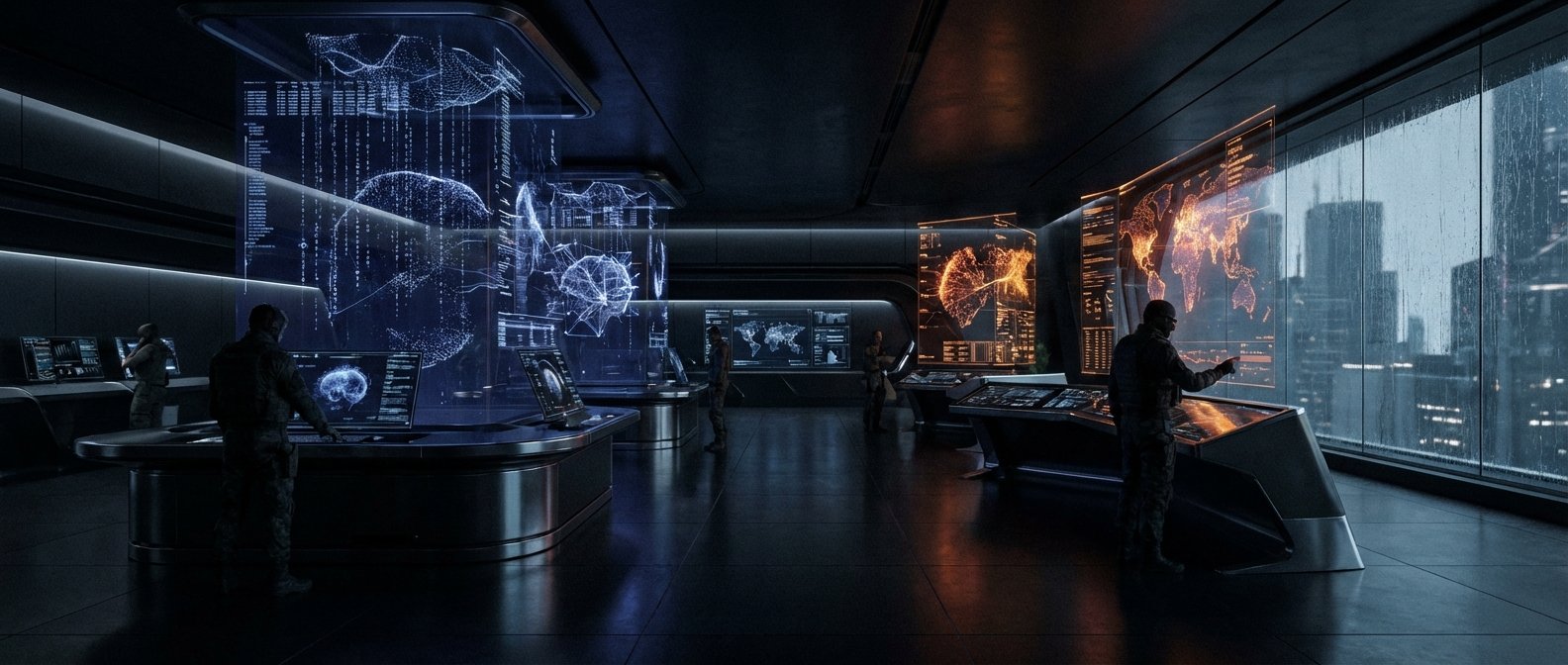

Estamos viviendo una transición acelerada donde la IA civil ya no es suficiente para las potencias globales. El Pentágono no quiere chatbots para escribir correos, quiere la infraestructura de procesamiento de lenguaje y visión más avanzada del mundo para integrarla en su stack de defensa. Esto nos plantea un dilema ético brutal: ¿puede una tecnología ser neutral cuando se despliega en un teatro de operaciones activo? Al lío, porque esto es solo la punta del iceberg.

Las Tres Capas de la IA en Defensa: Vigilancia, Decisión y Actuación

Para entender este despliegue, hay que dejar de pensar en «robots asesinos» de ciencia ficción y mirar la arquitectura del sistema. Yo lo divido en tres capas críticas que están redefiniendo la guerra moderna:

- Capa de Vigilancia: Recolección masiva de datos. Aquí es donde los modelos de visión por computadora analizan feeds de satélites y drones en tiempo real, identificando patrones que un humano tardaría semanas en procesar.

- Capa de Decisión: Es el corazón del asunto. Algoritmos de soporte que priorizan amenazas. No disparan, pero le dicen al operador: «Ojo con esto, el objetivo B tiene un 94% de probabilidad de ser una amenaza inminente».

- Capa de Actuación: El paso final. La integración de la IA con actuadores físicos. Aunque hoy la mayoría de sistemas requieren un humano que valide la acción, la latencia de combate está empujando el diseño hacia una autonomía cada vez mayor.

Anatomía de un Sistema de Armas Asistido por Algoritmos

En el diseño de sistemas de defensa, seguimos un ciclo técnico cerrado: Sensor, Percepción, Decisión y Actuación. La IA de OpenAI y sus competidores entra de lleno en la fase de percepción y decisión. Al integrar modelos de lenguaje (LLMs) y visión con hardware sensible, el sistema puede «entender» el contexto de una situación táctica compleja.

La gradación de la autonomía es el verdadero campo de batalla técnico. Pasar de un humano «en el bucle» (validando cada paso) a un humano «sobre el bucle» (solo supervisando) reduce los tiempos de respuesta a milisegundos. Bro, en un entorno de combate saturado, la velocidad no es solo una ventaja, es la arquitectura de supervivencia.

Divergencia Ética: Dos Caminos para la Industria

Estamos viendo una fractura total en la industria. Por un lado, empresas que mantienen principios rígidos de no-cooperación militar; por otro, las que abrazan los contratos del Pentágono como una evolución necesaria para la seguridad nacional. Lo que me escama como técnico es el lenguaje «intencionalmente vago» de estos nuevos principios éticos corporativos.

La presión comercial es gigantesca, pero la responsabilidad social del desarrollador no puede quedarse en un segundo plano. Cuando el flujo de datos va desde un satélite hasta un procesador neuronal para ejecutar un output táctico, la transparencia del código deja de ser un tema de «open source» y se convierte en una cuestión de derechos humanos básicos.

Riesgos en el Terreno: Sesgos, Opacidad y Escalada Automática

Aquí es donde la teoría choca con la realidad cruda. Los modelos de IA no son infalibles; tienen sesgos y alucinaciones. En un entorno civil, que ChatGPT te invente una fecha histórica es una anécdota. En el campo de batalla, si el modelo confunde a un civil con un objetivo por un error de clasificación en los datos de entrenamiento, las consecuencias son irreversibles.

Además, nos enfrentamos al «problema de la caja negra». Es prácticamente imposible auditar por qué una red neuronal profunda tomó una decisión militar específica en tiempo real. Esto genera ciclos de respuesta acelerados que superan la capacidad de intervención de cualquier líder político. Si dos IAs enemigas empiezan a escalar una respuesta en milisegundos, ¿quién tiene el botón de pausa?

«La automatización de la guerra no solo cambia cómo peleamos, cambia nuestra capacidad de detener el conflicto una vez iniciado.»

Gobernanza y Futuro: ¿Quién Controla el Algoritmo?

No todo está perdido, pero necesitamos movernos rápido. Se está empezando a hablar de una «Convención de Ginebra Digital». Necesitamos auditorías independientes de los modelos de defensa y, sobre todo, estándares de intervención humana obligatoria que no sean negociables.

El papel de la comunidad técnica es vital. Nosotros, los que entendemos qué hay bajo el capó, debemos ser los reguladores de facto, exigiendo transparencia y límites claros. La tecnología debe estar al servicio de la seguridad, no al servicio de una autonomía sin control. Al final del día, el código más importante es el que protege nuestra propia humanidad.